想要大幅降低人臉識別系統泄露隱私的風險?

先做個“影子模型”攻擊一遍就好了。

這不是說著玩,而是浙江大學和阿里巴巴合作提出的最新方法,已被CVPR 2023接收。

一般來說,人臉識別系統都采用客戶端-服務器模式,通過客戶端的特征提取器從面部圖像中提取特征,并將面部特征而非照片存儲在服務器端進行人臉識別。

盡管這樣能避免被拍下的人臉照片直接泄露,但現在也有一些方法能夠基于人臉特征信息來重構圖像,還是威脅了大家的隱私安全。

因此,浙江大學網絡空間安全學院王志波團隊聯合橙盾科技、深象智能,提出了全新方法,通過建立影子模型來模擬攻擊者的行為,捕捉從面部特征到圖像的映射函數,利用重構映射相似性,來產生對抗噪聲,破壞從特征到人臉的映射,完成對未知重構攻擊的抵御。

舉個不太恰當的比喻,這就好像是給人臉識別系統注射疫苗,讓它先產生“抗體”,這樣當病毒真正攻擊時,就能很好抵御了。

而且這一方法支持即插即用,無需修改網絡結構或者重新訓練網絡,測試結果表明,該方法表現達到SOTA。

增強隱私保護但不降低準確性

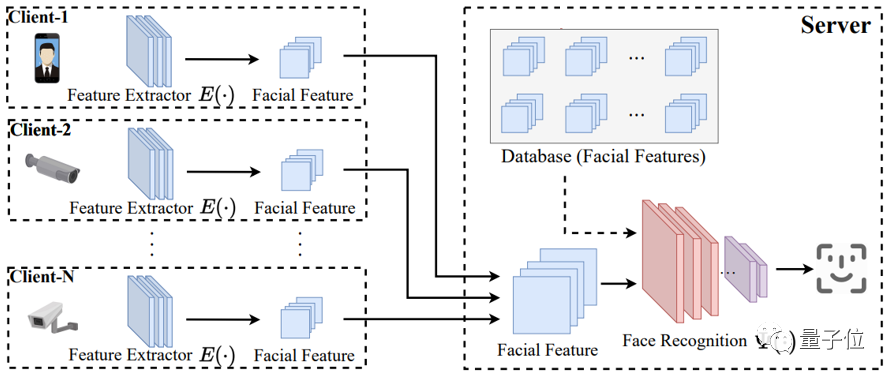

一般來說,人臉識別系統采用的客戶端/服務器架構的工作方式。

人臉識別網絡由服務器預先訓練,并在特定點將網絡分成特征提取器和分類決定器。

我們在系統內存入人臉密碼的過程,就是使用了提取器來獲取面部特征,然后系統會將特征發送到服務器。

在服務端,上傳的面部特征與數據庫中特征通過分類決定器驗證后,完成識別。

這樣的好處是用戶的人臉照片留在本地,真正上傳到云端只是特征信息。

但這也并不意味著系統會是絕對安全的。

因為攻擊者通過訪問人臉識別客戶端,獲取人臉識別系統中的特征提取器,進而通過任意圖像與其特征一對一的關系,訓練重構器。

再拿到數據庫中泄露的人臉特征,利用重構器就能恢復人臉圖像,竊取隱私。

這種重構攻擊模式可大致分為兩種:

基于優化

基于學習

前者通過逐步調整輸入圖像的像素,使特征提取器的輸出盡可能接近某一特征值,直到重構出與該特征對應的人臉圖像(即最初輸入圖像)。

后者是構建新的神經網絡訓練特征圖像解碼器,直接從面部特征中重建圖像。

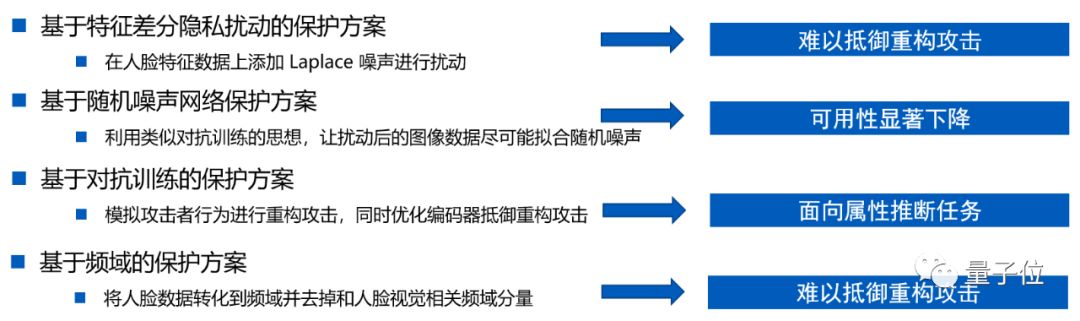

目前已經出現了一些人臉數據保護方法,但都還存在一定劣勢。

由此,本項研究提出了一種基于重構映射相似性的隱私保護對抗性人臉特征,來保護人臉識別系統的安全。

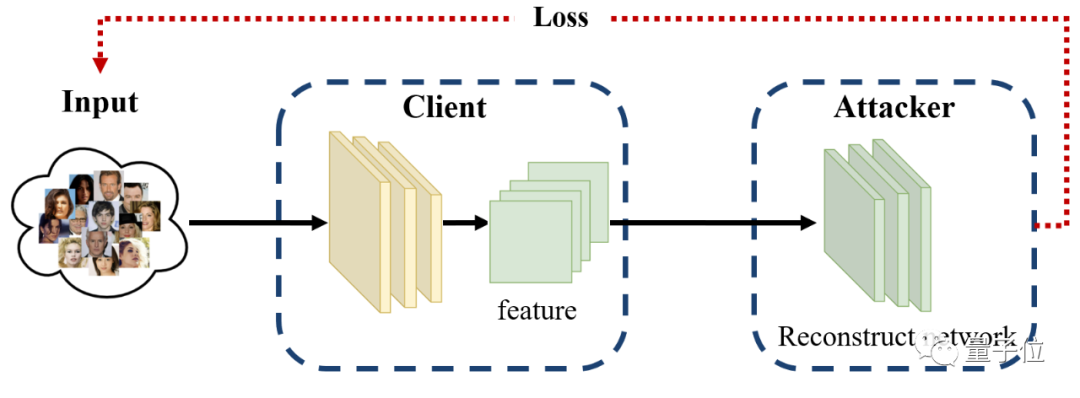

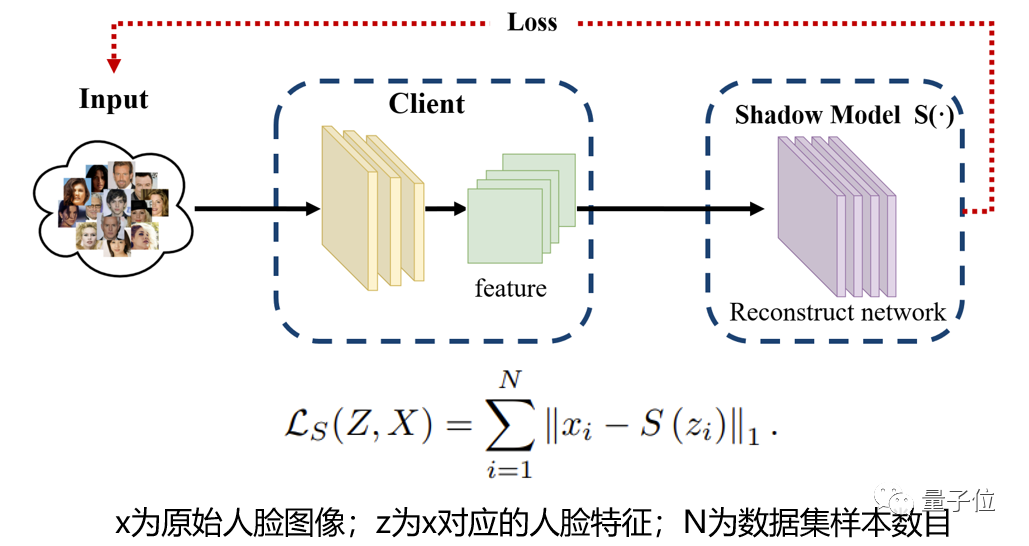

具體步驟就是在服務器端構建基于任意結構的影子模型S(·) 來模擬攻擊者的行為,并保證影子模型有能力重構人臉特征,利用重構映射相似性,捕捉從面部特征到圖像的映射函數。

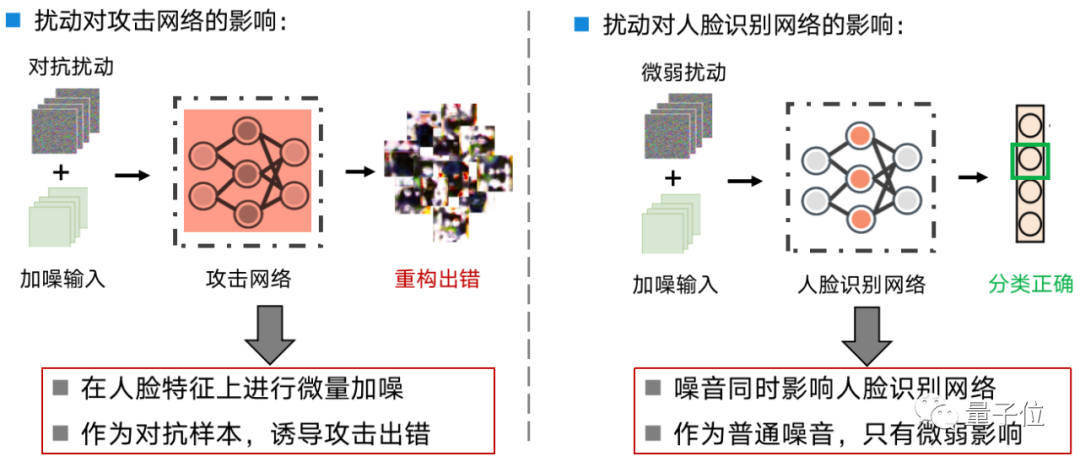

然后,利用影子模型的梯度信息來生成針對重構映射的對抗性噪聲來破壞從特征到人臉的映射,完成對未知重構攻擊的抵御,保護人臉隱私安全。

同時,作者對擾動強度進行了約束,分析了擾動強度對人臉識別精度與人臉隱私安全兩者關系的影響,實現保證人臉識別精度的同時,滿足隱私安全需求。

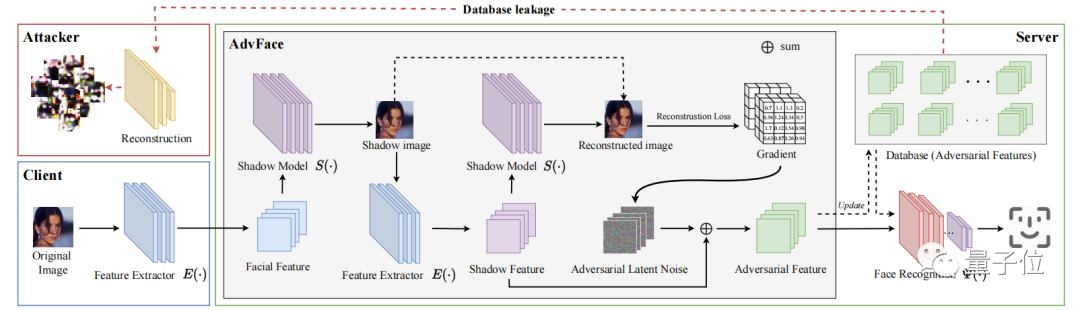

方法總覽如下,作者將其命名為AdvFace。

應用方面,該方法有兩種模式:

Online模式

Offline模式

Online模式下,AdvFace可以作為即插即用的隱私增強模塊集成到已部署的人臉識別系統,有效提升人臉數據對重構攻擊的防御能力。

Offline模式下,服務器可以使用對抗性特征和標簽重新訓練服務器端的下游人臉識別網絡,在保證安全性能不改變的情況下,提高人臉識別準確率。

實驗結果

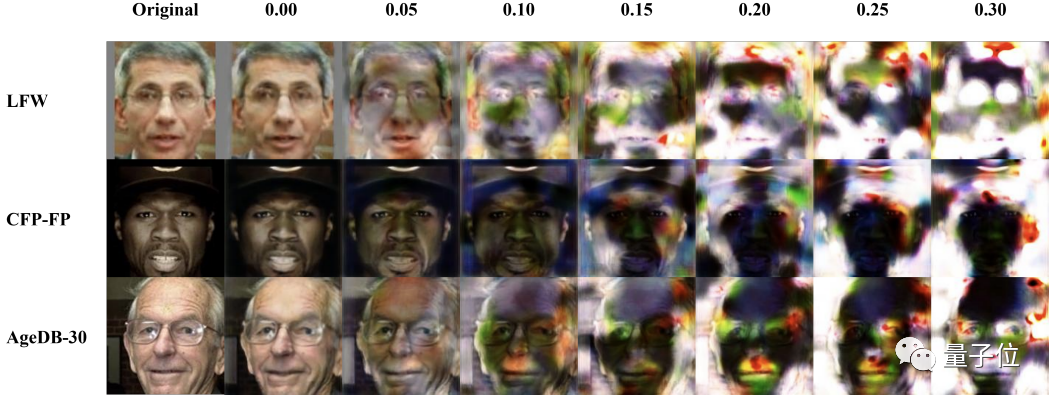

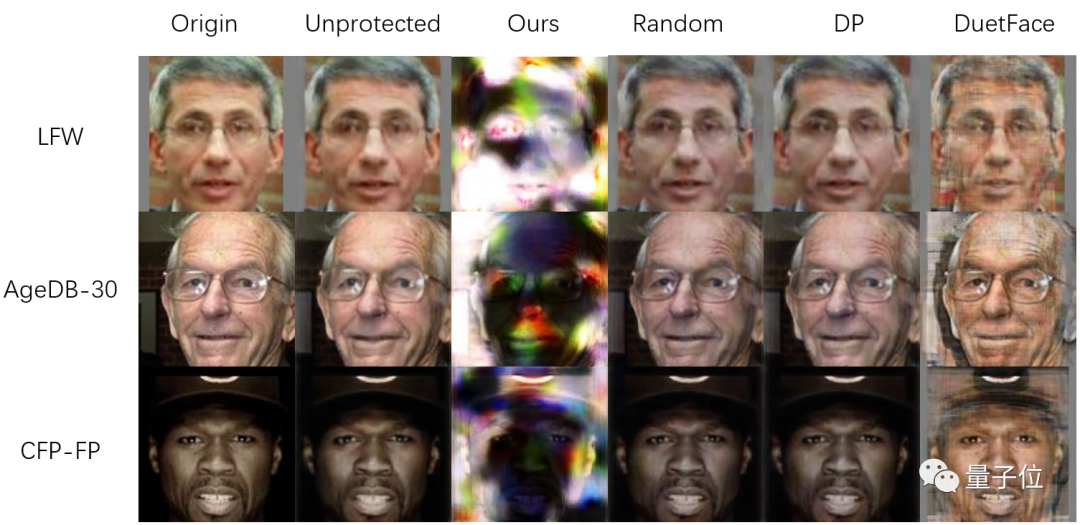

AdvFace提供了可選的人臉隱私保護強度,如下是該方法在不同保護強度下,人臉隱私保護的情況。

可以看到保護強度大于0.15后,隱私可以得到很好的保護。

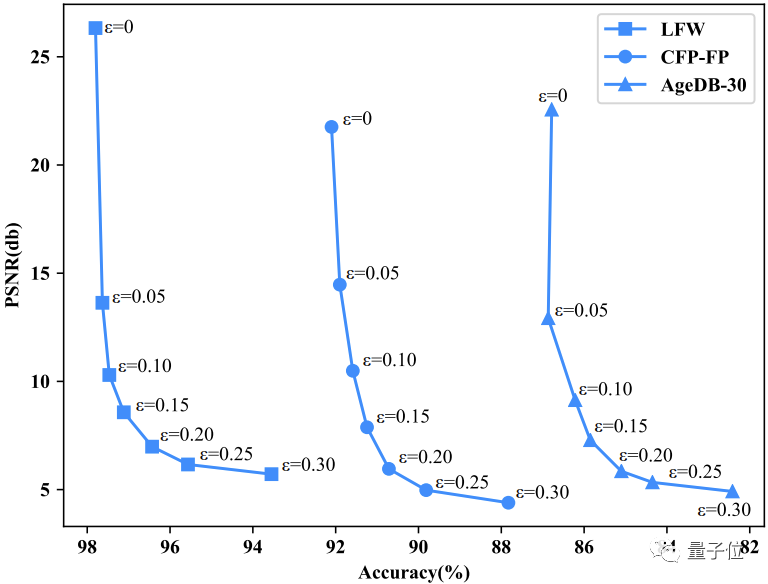

如下是不同噪聲強度下,重構圖片的PSNR指標和人臉識別精度。

在保護強度為0.2時,精度略有下降,但在防御重構攻擊和精度上取得了更好的平衡(圖表中越接近左下角越優,意味精度高的同時,對重構攻擊防御效果好)。

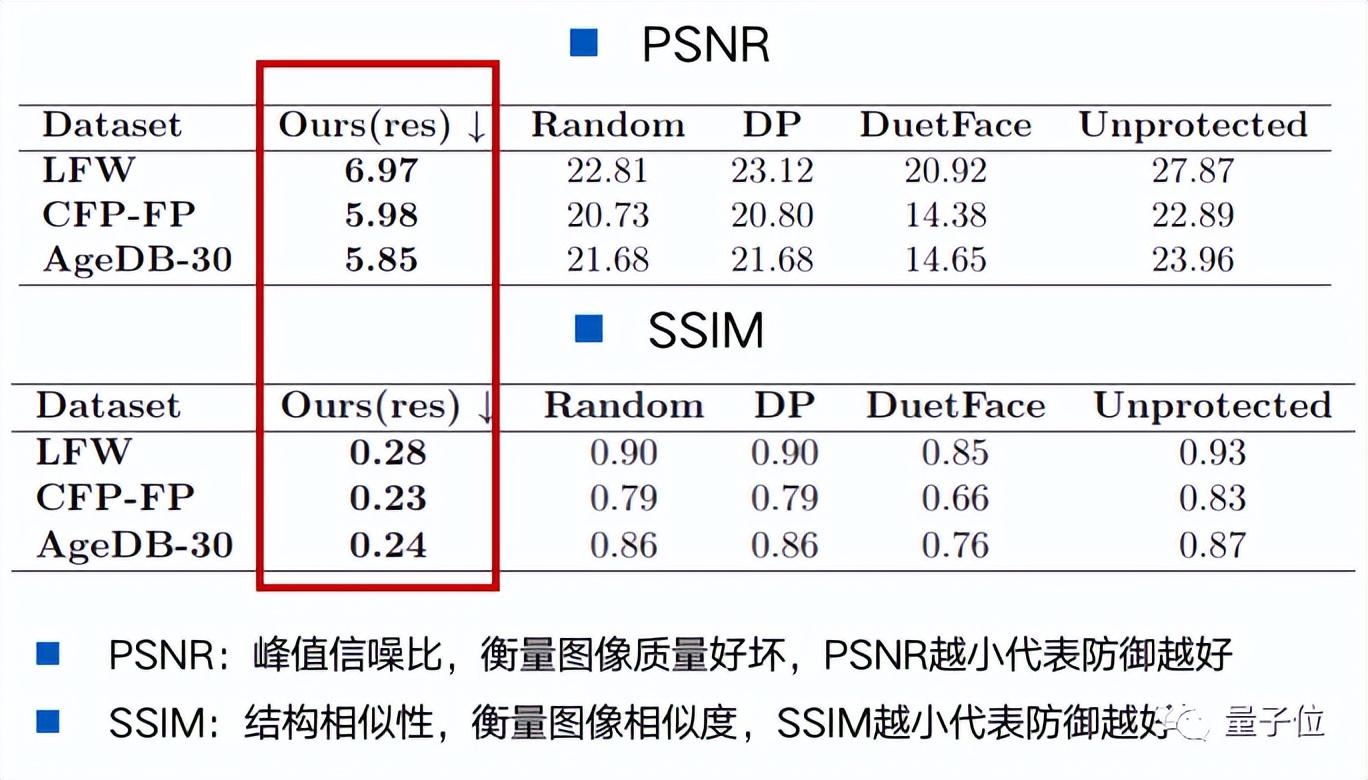

而在對重構攻擊的防御上,AdvFace的效果也明顯優于其他方法。

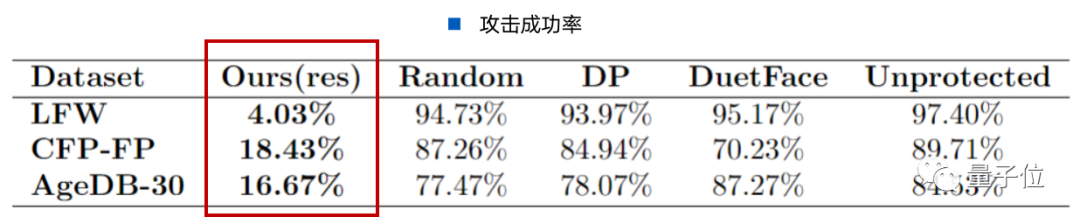

對于攻擊者使用重構圖片進行人臉認證的測試中,使用AdvFace后,攻擊成功率明顯低于其他方法。

如上所有結果表明,AdvFace在保持人臉識別準確度的同時,有效提升了人臉識別系統對重構攻擊的防御能力。

與此同時,它提出的重構攻擊映射的相似性,還為防御未知黑盒攻擊提供了理論支撐。

該成果發表于Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. 2023,是CCF推薦的人工智能領域A類會議。

CVPR 2023 Accepted papers:https://cvpr2023.thecvf.com/Conferences/2023/AcceptedPapers

論文地址:http://arxiv.org/abs/2305.05391