不法分子用針孔攝像頭違法偷拍的事兒,可以說是過段時間就上個新聞。

導致現在不少人出門住個酒店都要先用網上學來的方法查個遍,才能安心躺下。

然而像什么手機攝像頭檢測法、某寶上的檢測儀等費時費力,主要效果還不一定好……

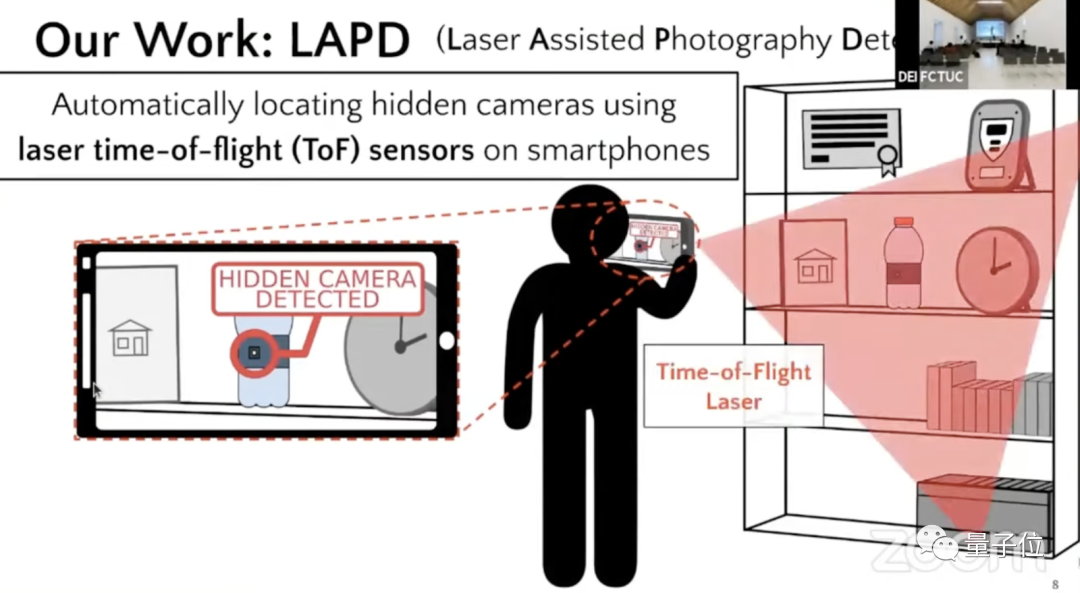

現在,來自新加坡國立大學的研究員們又開發出了一種新方法,用一部手機加一個智能應用程序,就能實現近90%的精準檢測率。

真的嗎?來看。

一部手機+機器學習APP揪出針孔攝像頭

首先,手機不是普通的手機,是帶有ToF (Time of light,飛行時間)傳感器的手機。

所謂ToF傳感器,就是傳感器發出經調制的近紅外光,遇物體后反射,然后通過計算光線發射和反射時間差或相位差,獲得被拍攝景物的距離,以產生深度信息。

其測量范圍可達數米、精度小于2cm,每秒更新頻率可達30~60 fps。

可在手機上用于人臉識別、金融支付、攝像時精準摳像/探測景深、AR建模與體感游戲等。

現在有部分手機已經配有ToF傳感器,比如iPhone 13、iPhone 12 Pro、Samsung S20+/Ultra、華為P30 Pro、OPPO RX17 Pro等。

沒有的也別著急,未來會漸漸成為一種趨勢。

進入正題。

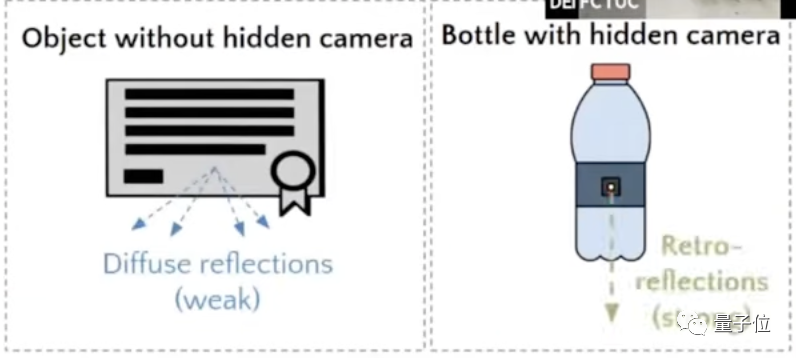

我們都知道,相比普通物體的“散射”,光線打在鏡頭這類物體上會形成強烈的逆反射,就像這樣:

一個更形象的比喻:

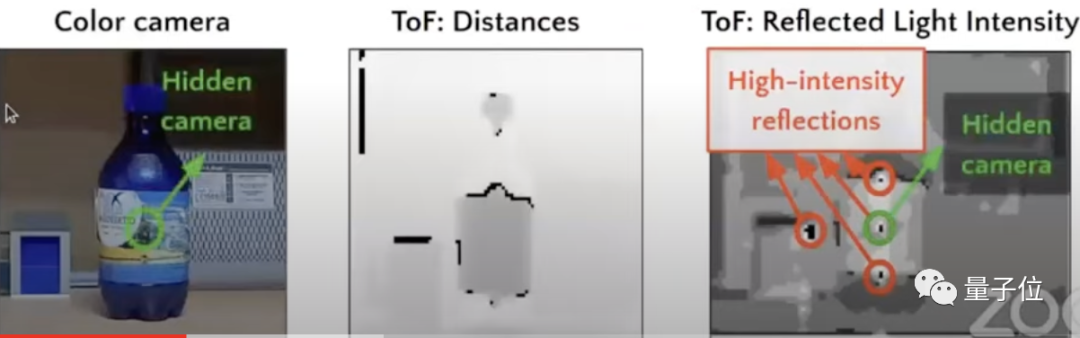

而ToF傳感器正好不僅能告訴你物體離攝像頭有多遠,還能反映圖像中每個像素有多亮。

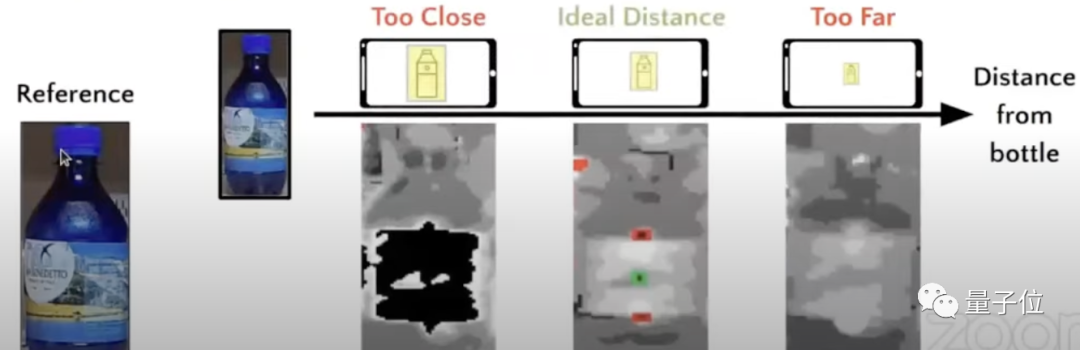

那就好辦了,就比如下圖最右,通過適當距離的ToF傳感器反射,我們可以發現四個高亮點,而其中一個就是針孔攝像頭藏身之處。

但是,問題也來了,四個亮點長得差不多,憑什么說中間那個就是呢?

另外,如果傳感器和嫌疑物的距離太近或太遠,給出的成像會“糊”就會造成誤報,那又不知道嫌疑物到底在哪,怎么選擇一個理想位置進行檢測呢?

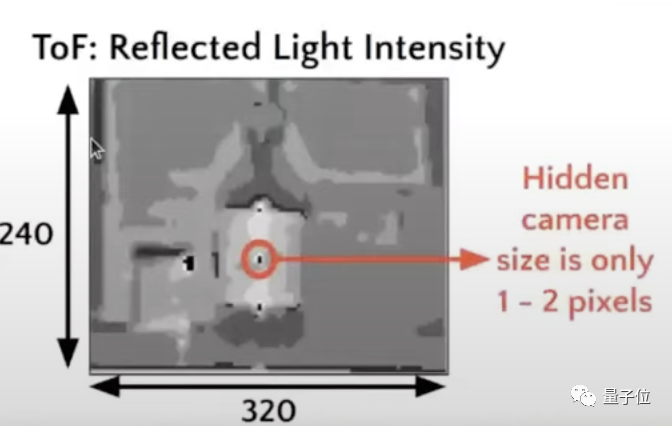

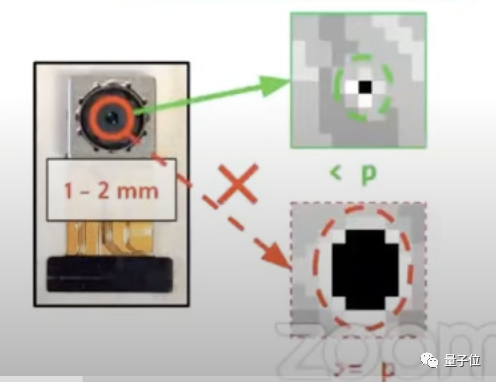

以及目前的ToF傳感器空間分辨率都非常低,只有240x320,這就導致一個針孔攝像頭的圖像可能就占1-2個像素;位深(bit-depth)也低,只能代表8種顏色,檢測難度直線上升,誤報率居高不下。

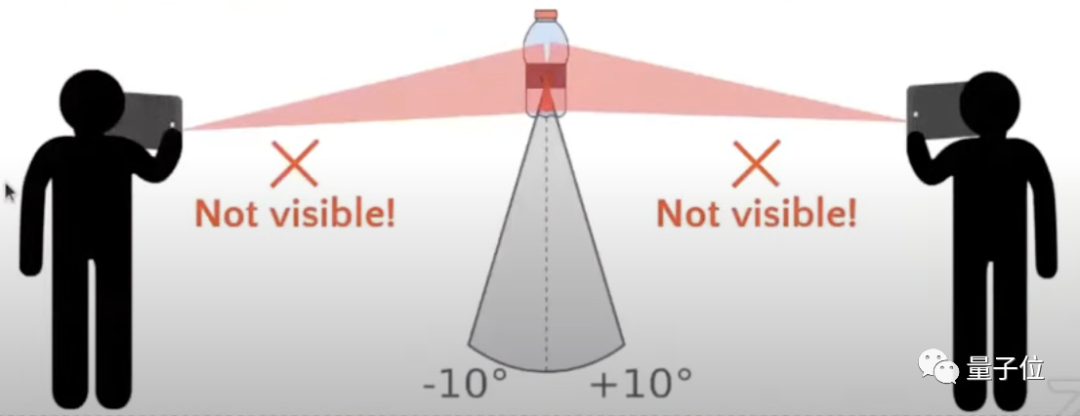

最后,嫌疑攝像頭反射的光只能在20°的視場角(FoV)范圍內可見,操作不當也會導致漏報。

好家伙,問題這么多,怎么解決?

這就得靠搭載了計算機視覺和機器學習的應用程序來幫忙了。

首先,使用手機攝像頭對準一些你嫌疑的對象,然后APP通過計算引導你和嫌疑對象保持合適的檢測距離(一般是20厘米)。

計算依據假定針孔攝像頭的直徑為1-2mm。

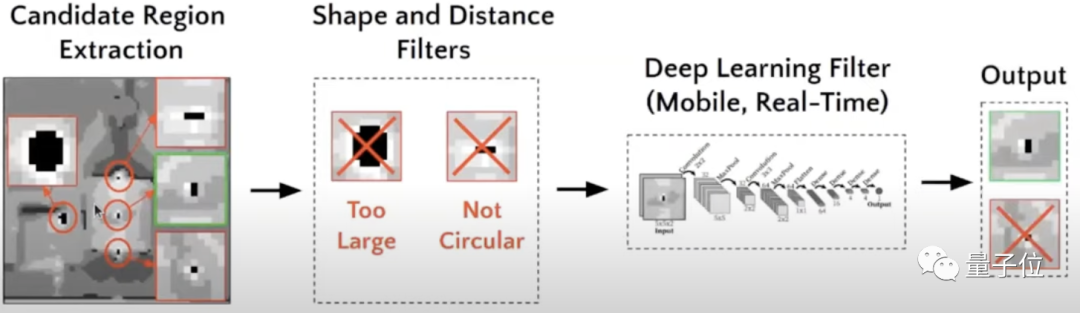

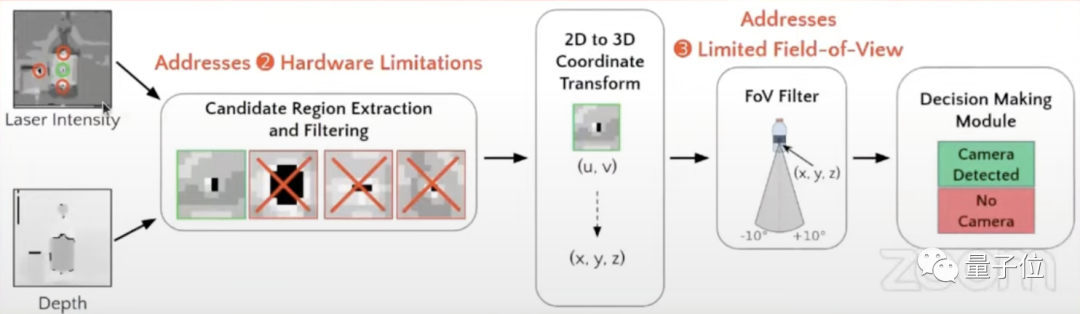

在掃描過程中,ToF傳感器的每一幀都給我們提供了激光強度圖像和深度圖像,程序將兩者結合,提取候選區域,然后根據物理知識和機器學習過濾掉形狀和距離基本不可能的選項。

接著將過篩的圖像通過坐標轉換從2D轉為3D,再通過FoV過濾器進行視場角過濾。

最終給出是否有針孔攝像頭的結論。

說了這么多,看看它的真本事吧。

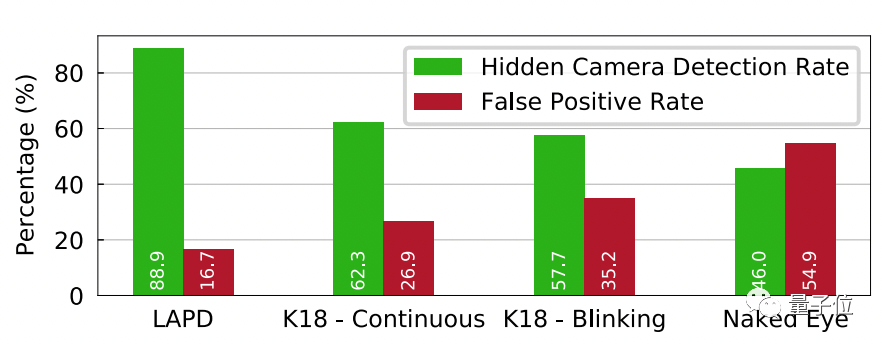

88.9%的檢測率

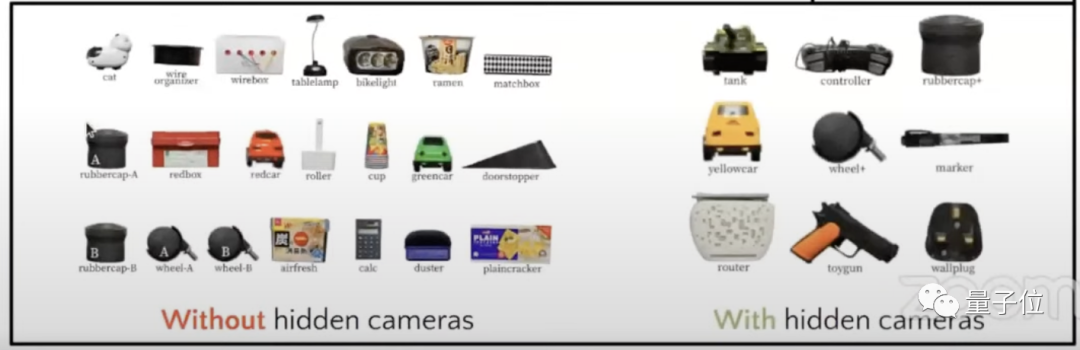

研究人員一共提供了21件不含和9件含針孔攝像頭的物品進行測試。

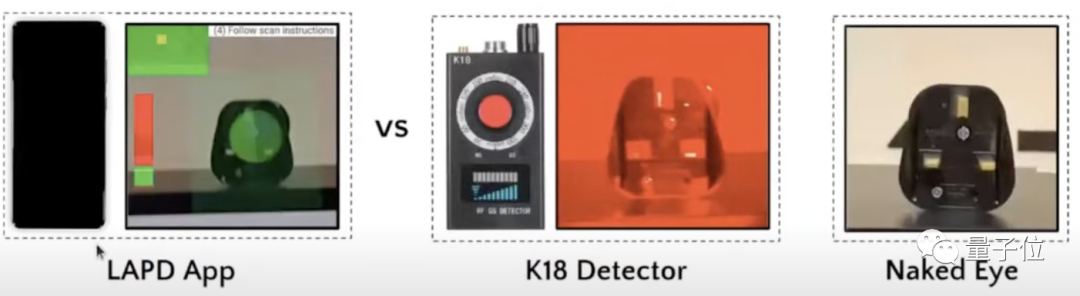

每件物品用三種檢測方法:ToF手機/LAPD APP(也就是他們的方法)+一種叫做K18的市面檢測儀+裸眼。

后兩者需人為進行可疑攝像頭的標注,一共379名志愿者參與。

最終,他們的方法最高獲得了88.9%的準確率,以及最低16.7%的誤報率。

比K18檢測儀高了近30%。

并且,APP在實驗用的Samsung S20+可以連續運行2個半小時。

看到這兒,網友都坐不住了,紛紛喊話:什么時候上線應用程序,戳我啊!

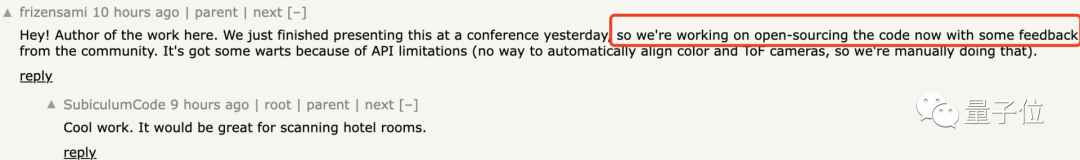

好消息是,作者回應了:

代碼正在開源。

那么,你覺得這個方法如何?到時發布了你會試試嗎?