云提供商正在組建 GPU 大軍,以提供更多的 AI 火力。在今天舉行的年度 Google I/O 開發(fā)者大會上,Google 宣布了一款擁有 26,000 個 GPU 的 AI 超級計算機——A3 ,這個超級計算機是谷歌與微軟爭奪 AI 霸權(quán)的斗爭中投入更多資源進行積極反攻的又一證據(jù)。

這臺超級計算機擁有大約 26,000 個 Nvidia H100 Hopper GPU。作為參考,世界上最快的公共超級計算機Frontier擁有 37,000 個 AMD Instinct 250X GPU。

對于我們最大的客戶,我們可以在單個集群中構(gòu)建多達 26,000 個 GPU 的 A3 超級計算機,并正在努力在我們最大的地區(qū)構(gòu)建多個集群,”谷歌發(fā)言人在一封電子郵件中說,并補充說“并非我們所有的位置都將是縮放到這么大的尺寸。”

該系統(tǒng)是在加利福尼亞州山景城舉行的 Google I/O 大會上宣布的。開發(fā)者大會已經(jīng)成為谷歌許多人工智能軟件和硬件能力的展示。在微軟將 OpenAI 的技術(shù)應(yīng)用于 Bing 搜索和辦公生產(chǎn)力應(yīng)用程序之后,谷歌加速了其 AI 開發(fā)。

該超級計算機面向希望訓練大型語言模型的客戶。谷歌為希望使用超級計算機的公司宣布了隨附的 A3 虛擬機實例。許多云提供商現(xiàn)在都在部署 H100 GPU,Nvidia 在 3 月份推出了自己的 DGX 云服務(wù),與租用上一代 A100 GPU 相比價格昂貴。

谷歌表示,A3 超級計算機是對現(xiàn)有 A2 虛擬機與 Nvidia A100 GPU 提供的計算資源的重大升級。谷歌正在將所有分布在不同地理位置的 A3 計算實例匯集到一臺超級計算機中。

“A3 超級計算機的規(guī)模可提供高達 26 exaflops 的 AI 性能,這大大減少了訓練大型 ML 模型的時間和成本,”谷歌的董事 Roy Kim 和產(chǎn)品經(jīng)理 Chris Kleban 在一篇博客文章中說。

公司使用 exaflops 性能指標來估計 AI 計算機的原始性能,但批評者仍然對其持保留意見。在谷歌的案例中,被大家詬病的是其結(jié)果在以 ML 為目標的 bfloat16(“brain floating point”)性能中計算出來的,這讓你達到“exaflops”的速度比大多數(shù)經(jīng)典 HPC 應(yīng)用程序仍然使用的雙精度 (FP64) 浮點數(shù)學要快得多要求。

GPU 的數(shù)量已經(jīng)成為云提供商推廣其 AI 計算服務(wù)的重要名片。微軟在 Azure 中的 AI 超級計算機與 OpenAI 合作構(gòu)建,擁有 285,000 個 CPU 內(nèi)核和 10,000 個 GPU。微軟還宣布了配備更多 GPU 的下一代 AI 超級計算機。Oracle 的云服務(wù)提供對 512 個 GPU 集群的訪問,并且正在研究新技術(shù)以提高 GPU 通信的速度。

谷歌一直在大肆宣傳其TPU v4 人工智能芯片,這些芯片被用于運行帶有 LLM 的內(nèi)部人工智能應(yīng)用程序,例如谷歌的 Bard 產(chǎn)品。谷歌的 AI 子公司 DeepMind 表示,快速 TPU 正在指導通用和科學應(yīng)用的 AI 開發(fā)。

相比之下,谷歌的 A3 超級計算機用途廣泛,可以針對廣泛的 AI 應(yīng)用程序和 LLM 進行調(diào)整。Kim 和 Kleban 在博文中表示:“鑒于這些工作負載的高要求,一刀切的方法是不夠的——你需要專為 AI 構(gòu)建的基礎(chǔ)設(shè)施。”

就像谷歌喜歡它的 TPU 一樣,Nvidia 的 GPU 已經(jīng)成為云提供商的必需品,因為客戶正在 CUDA 中編寫 AI 應(yīng)用程序,這是 Nvidia 專有的并行編程模型。該軟件工具包基于 H100 的專用 AI 和圖形內(nèi)核提供的加速生成最快的結(jié)果。

客戶可以通過 A3 虛擬機運行 AI 應(yīng)用程序,并通過 Vertex AI、Google Kubernetes Engine 和 Google Compute Engine 服務(wù)使用 Google 的 AI 開發(fā)和管理服務(wù)。公司可以使用 A3 超級計算機上的 GPU 作為一次性租用,結(jié)合大型語言模型來訓練大型模型。然后,將新數(shù)據(jù)輸入模型,更新模型——無需從頭開始重新訓練。

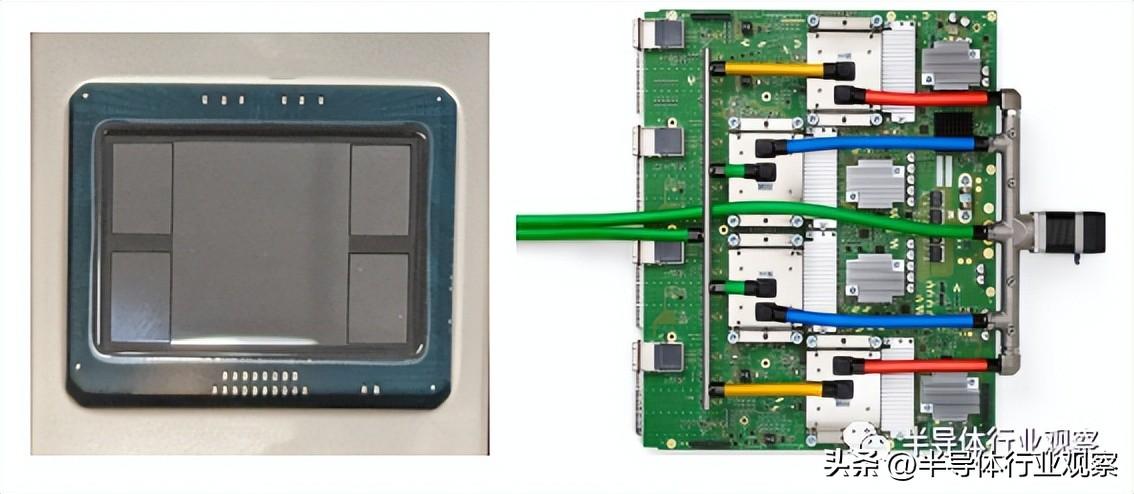

谷歌的 A3 超級計算機是各種技術(shù)的大雜燴,以提高 GPU 到 GPU 的通信和網(wǎng)絡(luò)性能。A3 虛擬機基于英特爾第四代 Xeon 芯片(代號 Sapphire Rapids),與 H100 GPU 一起提供。目前尚不清楚 VM 中的虛擬 CPU 是否會支持 Sapphire Rapids 芯片中內(nèi)置的推理加速器。VM 隨附 DDR5 內(nèi)存。

Nvidia H100 上的訓練模型比在云端廣泛使用的上一代 A100 GPU 更快、更便宜。人工智能服務(wù)公司 MosaicML 進行的一項研究發(fā)現(xiàn),H100 在其 70 億參數(shù)的 MosaicGPT 大型語言模型上“比 NVIDIA A100 的成本效益高 30%,速度快 3 倍”。

H100 也可以進行推理,但考慮到 H100 提供的處理能力,這可能被認為是矯枉過正。谷歌云提供 Nvidia 的 L4 GPU 用于推理,英特爾在其 Sapphire Rapids CPU 中擁有推理加速器。

“A3 VM 也非常適合推理工作負載,與我們的 A2 VM 的 A100 GPU 相比,推理性能提升高達 30 倍,”Google 的 Kim 和 Kleban 說。

A3 虛擬機是第一個通過名為 Mount Evans 的基礎(chǔ)設(shè)施處理單元連接 GPU 實例的虛擬機,該單元由谷歌和英特爾聯(lián)合開發(fā)。IPU 允許 A3 虛擬機卸載網(wǎng)絡(luò)、存儲管理和安全功能,這些功能傳統(tǒng)上是在虛擬 CPU 上完成的。IPU 允許以 200Gbps 的速度傳輸數(shù)據(jù)。

“A3 是第一個使用我們定制設(shè)計的 200Gbps IPU 的 GPU 實例,GPU 到 GPU 的數(shù)據(jù)傳輸繞過 CPU 主機并流經(jīng)與其他 VM 網(wǎng)絡(luò)和數(shù)據(jù)流量不同的接口。與我們的 A2 虛擬機相比,這使網(wǎng)絡(luò)帶寬增加了 10 倍,具有低尾延遲和高帶寬穩(wěn)定性,”谷歌高管在一篇博客文章中說。

IPU 的吞吐量可能很快就會受到微軟的挑戰(zhàn),微軟即將推出的配備 Nvidia H100 GPU 的 AI 超級計算機將擁有該芯片制造商的 Quantum-2 400Gbps 網(wǎng)絡(luò)功能。微軟尚未透露其下一代 AI 超級計算機中 H100 GPU 的數(shù)量。

A3 超級計算機建立在源自公司 Jupiter 數(shù)據(jù)中心網(wǎng)絡(luò)結(jié)構(gòu)的主干上,該主干通過光學鏈路連接地理上不同的 GPU 集群。

“對于幾乎每一種工作負載結(jié)構(gòu),我們都實現(xiàn)了與更昂貴的現(xiàn)成非阻塞網(wǎng)絡(luò)結(jié)構(gòu)無法區(qū)分的工作負載帶寬,”谷歌表示。

谷歌還分享說,A3 超級計算機將有八個 H100 GPU,它們使用 Nvidia 專有的交換和芯片互連技術(shù)互連。GPU 將通過 NVSwitch 和 NVLink 互連連接,其通信速度約為 3.6TBps。Azure 在其 AI 超級計算機上提供了相同的速度,并且兩家公司都部署了 Nvidia 的電路板設(shè)計。

“每臺服務(wù)器都使用服務(wù)器內(nèi)部的 NVLink 和 NVSwitch 將 8 個 GPU 互連在一起。為了讓 GPU 服務(wù)器相互通信,我們在 Jupiter DC 網(wǎng)絡(luò)結(jié)構(gòu)上使用了多個 IPU,”一位谷歌發(fā)言人說。

該設(shè)置有點類似于 Nvidia 的 DGX Superpod,它具有 127 個節(jié)點的設(shè)置,每個 DGX 節(jié)點配備八個 H100 GPU。

谷歌博客:配備 NVIDIA H100 GPU 的 A3 超級計算機

實施最先進的人工智能 (AI) 和機器學習 (ML) 模型需要大量計算,既要訓練基礎(chǔ)模型,又要在這些模型經(jīng)過訓練后為它們提供服務(wù)。考慮到這些工作負載的需求,一種放之四海而皆準的方法是不夠的——您需要專為 AI 構(gòu)建的基礎(chǔ)設(shè)施。

我們與我們的合作伙伴一起,為 ML 用例提供廣泛的計算選項,例如大型語言模型 (LLM)、生成 AI 和擴散模型。最近,我們發(fā)布了 G2 VMs,成為第一個提供新的 NVIDIA L4 Tensor Core GPU 用于服務(wù)生成式 AI 工作負載的云。今天,我們通過推出下一代 A3 GPU 超級計算機的私人預(yù)覽版來擴展該產(chǎn)品組合。Google Cloud 現(xiàn)在提供一整套 GPU 選項,用于訓練和推理 ML 模型。

Google Compute Engine A3 超級計算機專為訓練和服務(wù)要求最嚴苛的 AI 模型而打造,這些模型為當今的生成式 AI 和大型語言模型創(chuàng)新提供動力。我們的 A3 VM 結(jié)合了 NVIDIA H100 Tensor Core GPU 和 Google 領(lǐng)先的網(wǎng)絡(luò)技術(shù),可為各種規(guī)模的客戶提供服務(wù):

1. A3 是第一個使用我們定制設(shè)計的 200 Gbps IPU的 GPU 實例,GPU 到 GPU 的數(shù)據(jù)傳輸繞過 CPU 主機并流過與其他 VM 網(wǎng)絡(luò)和數(shù)據(jù)流量不同的接口。與我們的 A2 VM 相比,這可實現(xiàn)高達 10 倍的網(wǎng)絡(luò)帶寬,同時具有低尾延遲和高帶寬穩(wěn)定性。

2. 我們行業(yè)獨一無二的智能 Jupiter 數(shù)據(jù)中心網(wǎng)絡(luò)結(jié)構(gòu)可擴展到數(shù)萬個高度互連的 GPU,并允許全帶寬可重新配置的光學鏈路,可以按需調(diào)整拓撲。對于幾乎每種工作負載結(jié)構(gòu),我們實現(xiàn)的工作負載帶寬與更昂貴的現(xiàn)成非阻塞網(wǎng)絡(luò)結(jié)構(gòu)沒有區(qū)別,從而降低了 TCO。

3. A3 超級計算機的規(guī)模提供高達 26 exaFlops 的 AI 性能,這大大減少了訓練大型 ML 模型的時間和成本。

隨著公司從訓練過渡到提供 ML 模型,A3 VM 也非常適合推理工作負載,與我們由 NVIDIA A100 Tensor Core GPU* 提供支持的 A2 VM 相比,推理性能提升高達 30 倍。

A3 GPU VM 專門為當今的 ML 工作負載提供最高性能的訓練,配備現(xiàn)代 CPU、改進的主機內(nèi)存、下一代 NVIDIA GPU 和主要網(wǎng)絡(luò)升級。以下是 A3 的主要特點:

1. 8 個 H100 GPU,利用 NVIDIA 的 Hopper 架構(gòu),提供 3 倍的計算吞吐量

2. 通過 NVIDIA NVSwitch 和 NVLink 4.0,A3 的 8 個 GPU 之間的對分帶寬為 3.6 TB/s

3. 下一代第 4 代英特爾至強可擴展處理器

4. 2TB 主機內(nèi)存,通過 4800 MHz DDR5 DIMM

5. 由我們支持硬件的 IPU、專門的服務(wù)器間 GPU 通信堆棧和 NCCL 優(yōu)化提供支持的網(wǎng)絡(luò)帶寬增加 10 倍

A3 GPU VM 是客戶開發(fā)最先進的 ML 模型的一個進步。通過顯著加快 ML 模型的訓練和推理,A3 VM 使企業(yè)能夠快速訓練更復雜的 ML 模型,為我們的客戶創(chuàng)造機會來構(gòu)建大型語言模型 (LLM)、生成 AI 和擴散模型,以幫助優(yōu)化運營并在競爭中保持領(lǐng)先地位。

此次發(fā)布基于我們與 NVIDIA 的合作伙伴關(guān)系,旨在為我們的客戶提供用于訓練和推理 ML 模型的全方位 GPU 選項。

NVIDIA 超大規(guī)模和高性能計算副總裁 Ian Buck 表示:“由下一代 NVIDIA H100 GPU 提供支持的 Google Cloud 的 A3 VM 將加速生成 AI 應(yīng)用程序的訓練和服務(wù)。” “在谷歌云最近推出 G2 實例之后,我們很自豪能夠繼續(xù)與谷歌云合作,通過專門構(gòu)建的人工智能基礎(chǔ)設(shè)施幫助全球企業(yè)轉(zhuǎn)型。”

對于希望在無需維護的情況下開發(fā)復雜 ML 模型的客戶,您可以在 Vertex AI 上部署 A3 VM,Vertex AI 是一個端到端平臺,用于在專為低延遲服務(wù)和高性能而構(gòu)建的完全托管基礎(chǔ)設(shè)施上構(gòu)建 ML 模型訓練。今天,在Google I/O 2023上,我們很高興通過向更多客戶開放 Vertex AI 中的生成 AI 支持以及引入新功能和基礎(chǔ)模型來構(gòu)建這些產(chǎn)品。

對于希望構(gòu)建自己的自定義軟件堆棧的客戶,客戶還可以在 Google Kubernetes Engine (GKE) 和 Compute Engine 上部署 A3 VM,以便您可以訓練和提供最新的基礎(chǔ)模型,同時享受自動縮放、工作負載編排和自動升級。

“Google Cloud 的 A3 VM 實例為我們提供了計算能力和規(guī)模,可滿足我們最苛刻的訓練和推理工作負載。我們期待利用他們在 AI 領(lǐng)域的專業(yè)知識和在大規(guī)模基礎(chǔ)設(shè)施方面的領(lǐng)導地位,為我們的 ML 工作負載提供強大的平臺。” -Noam Shazeer,Character.AI 首席執(zhí)行官

在谷歌云,人工智能是我們的 DNA。我們應(yīng)用了數(shù)十年為 AI 運行全球規(guī)模計算的經(jīng)驗。我們設(shè)計了該基礎(chǔ)架構(gòu)以擴展和優(yōu)化以運行各種 AI 工作負載——現(xiàn)在,我們將其提供給您。