AI詐騙現在有多兇猛?

這兩天,一條#AI詐騙成功率接近100%#的詞條直沖微博熱搜。

點進去一看,原來是福建一家科技公司的法人代表在10分鐘內就被騙走了430萬元……

怎么騙的?

“好友”通過微信視頻聯系到他,說自己的朋友在外地競標,需要430萬保證金,且需要公對公賬戶過賬,就想要借他公司的賬戶走一下。

基于視頻聊天信任的前提下,他在收到轉賬截圖后沒有核實錢款到賬就立馬“轉回去”430萬元。

轉完之后,他主動給好友發微信告知卻收到了一個問號,這才恍然大悟:

中了AI的高端大計,一點都沒看出來“朋友”的臉和聲音都是假的。

無獨有偶,就在不久之前,國外也發生了一起和AI相關的詐騙:

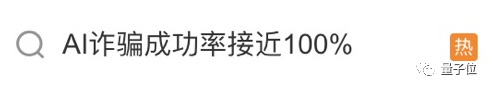

有團伙以“YouTube團隊”之名向一些YouTube博主們發送了一封電子郵件,文中給了一個谷歌云盤鏈接,要大家下載PDF獲悉平臺一項新政策的細則(跟大伙兒都比較相關)。

一般看到這兒,警惕心強的人可能還不為所動。

但郵件中卻附有堂堂谷歌CEO皮查伊“親自現身”說明的視頻,這立馬就打消了不少人最后的提防之心。

他們迅速點擊鼠標下好了文件,卻全然不知,這個文件表面看起來是一個PDF,打開之后確實也是講的新規則細節,實際卻是一個高度偽裝的病毒,可以直接獲取瀏覽器的cookie信息、保存的密碼等,非常危險。

可以看到,在這兩起事件之中,深度偽造技術deepfake都在其中起到了非常關鍵的作用。

提起這項已誕生了6年之久的換臉大法,不少人可能都對它有些“見怪不怪”了。

但如上所見,相關詐騙案件或大或小,并沒有削弱之勢。

相反,如今隨著AIGC技術的大爆發,普通人接觸到各種先進生成工具變得不費吹灰之力,制作出越發難以識別的高質量deepfake視頻也越來越容易,我們想要一眼識破出來這些造假內容就更加困難。

人臉識別在金融行業應用非常普遍,金融行業也因此最為重視防深偽攻擊。

而且隨著大模型驅動的AI新技術躍遷,這種潛在的威脅和危害越來越顯著。

但實際上,應對deepfake其實早已有比較成熟的技術方法和方案。

源自百度的金融科技公司度小滿在deepfake應對方法已經積累了豐富的經驗。

今天,我們或許可以再次重溫與盤點它們的破解之道,來給未來的防深偽工作指明方向。

金融領域防深偽,人臉是第一步

如度小滿數據智能部總經理、度小滿技術委員會執行主席楊青所說:

金融領域的AI防深偽,應該針對整個閉環、每個節點的安全性進行鞏固和創新。

但第一步就是從deepfake這種技術的單點突破開始。

在金融行業,由deepfake產生的主要欺詐行為就是身份欺詐,也就是通過深度偽造的虛假圖像和視頻,來冒充他人身份,騙過金融信貸流程中的身份核驗系統(包括活體檢測)。

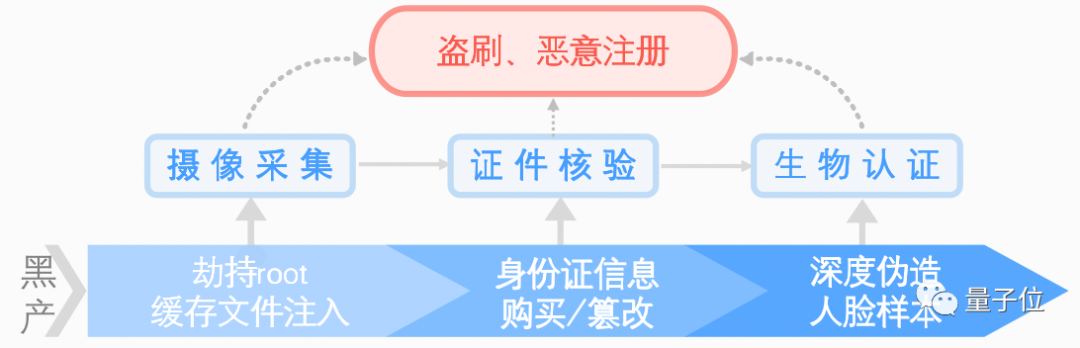

不法分子的欺詐方法其實也很簡單,就是先通過劫持root或者緩存文件注入等形式劫持你手機的攝像頭,不讓它進行真實采集。

然后上傳提前準備好的虛假證件信息(或經過篡改處理,或直接從黑產處購買)和通過深偽技術/AIGC技術生成的人臉樣本了。

如果系統恰好沒有檢測出來,盜刷和惡意注冊就可能隨之而來,給金融機構和用戶造成不易挽回的經濟損失。

度小滿介紹,近些年,隨著deepfake技術的不斷成熟,以及圖像視頻生成技術的流行,這種利用深偽技術繞過人臉識別流程的趨勢有所增長,對金融機構一直以來使用的實名認證系統造成了一定的威脅。

數據顯示,國內主要金融機構及互聯網公司應用的人臉驗證流程,70%以上存在被繞過的風險。

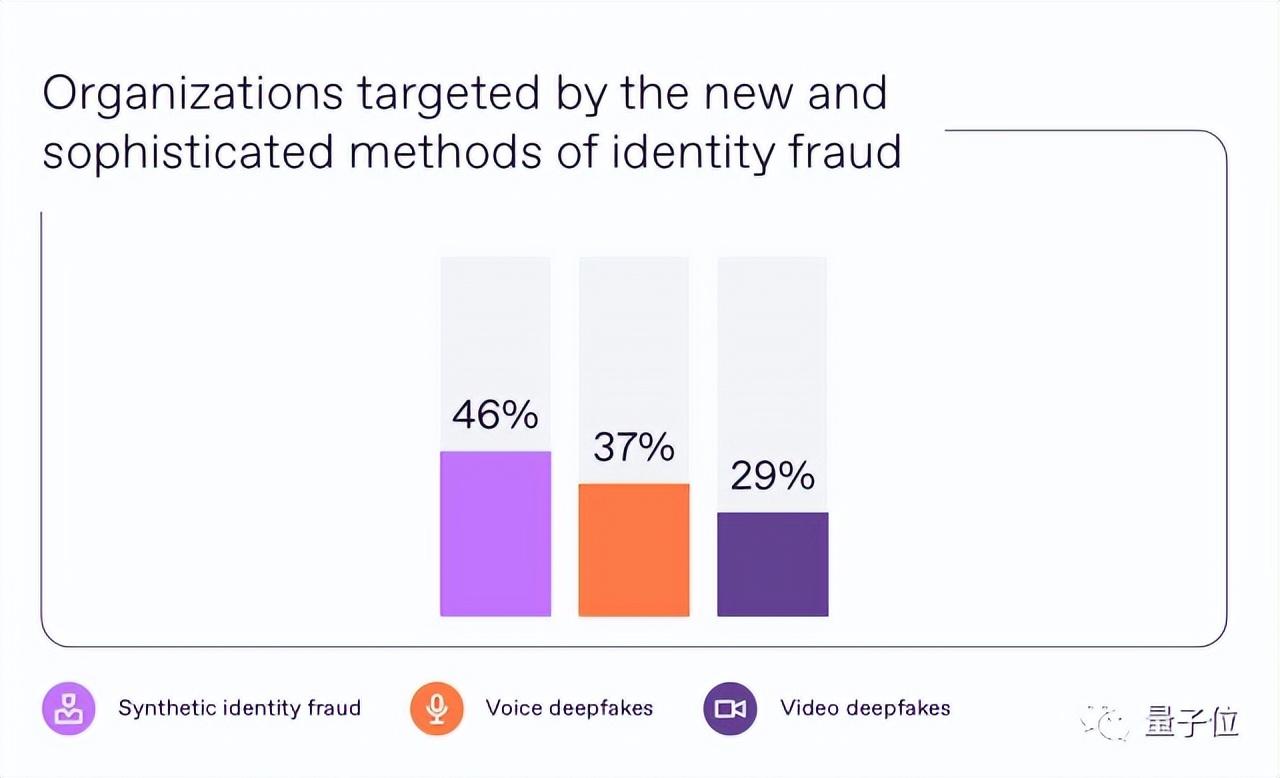

在全球范圍內,也有快接近一半(46%)的企業遭受過合成身份的欺詐,有高達90%的受訪企業認為這種行為已日益嚴重。

在應對方式上,除了直接切斷不法分子對手機系統權限進行篡改的能力,就是去識別認證內容是否造假。

對于后者來說,傳統的人工審核靠一些辨認技巧可以識別出部分deepfake內容,比如看面部輪廓流暢度、唇形一致性等。

但隨著deepfake技術替換本領越來越高超,再怎么訓練有素的眼睛也難以識別出其中破綻。

就比如下面這組,你能一眼看出來哪個是真嗎?

再者,人工審核方式的效率也很低,人工費更是高昂。

所謂“解鈴還須系鈴人”,最好的辦法還是交給AI去辦。

事實上,在deepfake技術出來不久之后,各種“反deepfake”檢測算法就陸續被技術大佬們研發出來了,貫徹的就是“你在前面飛,我在后面追”的思想。

大家能夠感受到,在各種金融App中實際的身份驗證環節中,我們只用幾秒鐘的時間就能完成刷臉、活體檢測、登錄等一系列操作,檢測過程完全無感。

這是因為防深偽模型經過了海量的樣本比對學習,“閱盡千帆”,哪怕只是細微到一個像素級的破綻也能迅速被它抓到。

除了實時識別和超高準確度,這種方法的價值相比人工審核,還體現在能夠非常方便地進行持續優化上。

那么,下面就以度小滿為例,來看看防深偽檢測模型具體是如何識別的。

三大細節入手,破解造假視頻

度小滿防深偽攻擊的算法策略主要從三個方面的破綻入手。

首先是生成瑕疵。

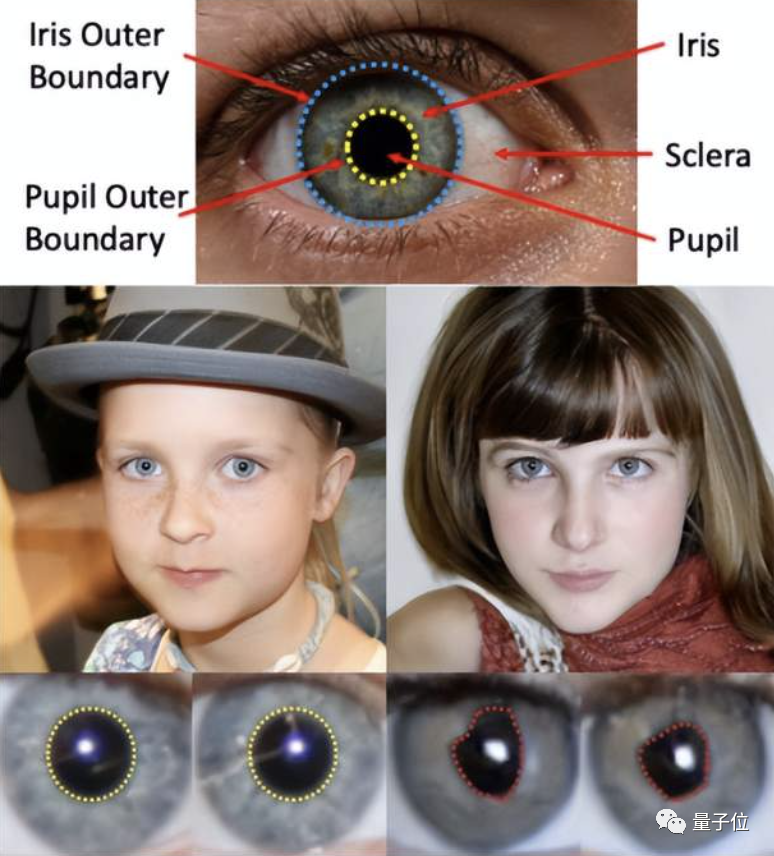

具體而言,由于相關訓練數據的缺失,deepfake模型可能缺乏一些生理常識,導致無法正確渲染部分人類面部特征。

問題小到眨眼頻率不正常、瞳孔形狀不規則、牙齒有缺陷,大到口型與聲音不吻合,肢體動作與演講內容不協調……

在檢測模型中,我們將這些“基本肉眼可見”的特征都提取出來,設計特定的分析算子,就可以進行分析研判。

其次是固有屬性。這指的是生成工具、攝像頭光感元件固有的噪聲指紋。

不同攝像機擁有不同的設備指紋就不多說了,像GAN這種模型在生成人臉時也會留下獨特的用于識別生成器的指紋,所以我們經過對比就能發現端倪。

不過需要注意,實際情況中,一些deepfake視頻可能被壓縮導致圖像被強降噪,所以像該網絡對固有屬性的微觀紋理分析就不管用了。

沒關系,我們還可以追究第三個細節:高層語義。

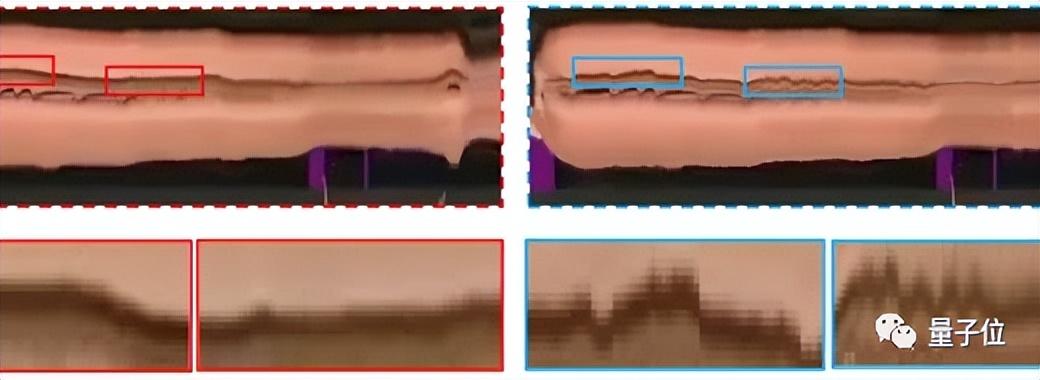

它指的是檢測面部動作單元(肌肉群)協調性、面部各區域朝向一致性、視頻微觀連續性(如下圖右產生的細微抖動)等方面的問題,由于這些細節建模困難、難以復制,很容易抓到把柄。

毫無疑問,由于單一特征難以適應復雜的deepfake內容,因此檢測模型的整體框架采用的是多特征融合,以此來保證決策的魯棒性。

一般來說,行業各家公司在破解deepfake視頻上采取的思路和以上所講差別不大,但度小滿還是在數據樣本優勢之外,融入了自己的獨創點,包括:

神經網絡搜索調優算法、微表情分析和圖卷積(GCN)技術以及基于重建的自監督預訓練方法,讓模型實現了從“鑒偽”到“鑒真”的轉變。

也正因此,去年9月,度小滿防深偽檢測模型順利通過了信通院人臉識別安全專項評測,獲得活體檢測安全防護能力優秀級認證。

具體效果上,它可以做到覆蓋各種深偽形式,包含靜態人像圖片活化、AI換臉、人臉虛假合成等,達到千分之一誤報率下召回90%以上,也就是99%+的準確率。

像咱們開頭所提的谷歌CEO皮查伊偽造視頻,之前微博上紅極一時的“馬一龍”,度小滿都能輕松識破:

值得注意的是,楊青表示,在模型的實際測試中,其實還是遇到一些出其不意的攻擊手段,比如經過對抗攻擊干擾的高糊視頻、3D頭模等。

對此,度小滿的總體解決策略是具體問題具體分析,即:

每遇到一個新的case,就專門構去建一個單獨的網絡結構算法來解決,如果發現對應情況增多后,就合并到通用的主體網絡結構中。

由此恰到好處地解決了各種問題。

AIGC技術爆發帶來的新挑戰

我們觀察到,就在最近幾個月,網上又涌現出了一大批號稱免費、甚至能在一秒、三次點擊以內就實現任意換臉的新deepfake工具,不限于圖片、視頻甚至是直播場景,效果也實在令人稱贊。

這也意味著,普通人乃至不法分子接觸到這種技術的方式越來越簡單了。

隨著諸如此類“亦正亦邪”的更多工具上線,可以想象,金融乃至其他行業以后要應對的偽造攻擊,將會有多么多種多樣。

值得注意的是,這類新造假內容其實給防深偽技術也帶來了全新的挑戰。

因為它們持有的是一些完全不同的新特征,目前已完備的“打假”方法其實是有些力不從心。

那么,我們應該怎么辦?

對此,度小滿從細處著手,給出了一些自己的觀點:

未來更多的鑒偽技術應該集中去挖掘語義特征、跨模態特征等,讓模型利用可解釋性強的高層語義去鑒偽。