目前,人工智能按照進化階段分為了弱人工智能(ANI)、通用人工智能(AGI)和超人工智能(ASI)三個階段。自1956年麥卡錫、明斯基等科學家首次提出“人工智能(Artificial Intelligence,簡稱AI)”這一概念,標志著人工智能學科的誕生;到2017年,谷歌Transformer模型的發布顛覆了傳統的自然語言處理模型,奠定了生成式AI的基礎;再到2022年,OpenAI正式發布 ChatGPT并在短短2個月內實現了用戶數破億,大量類ChatGPT的通用人工智能隨之涌現,正式揭開了AGI時代的序幕。正如微軟CEO薩提亞 · 納德拉所說,“AI的黃金時代正在到來,并將重新定義我們對工作的全部認識”。在各個行業中,必將涌現出無數基于類似GPT-4這樣的通用AGI平臺的創新應用,重構行業的產品、服務和流程,進而影響我們每一個人的工作、生活和學習。

新華三集團副總裁、互聯網事業部總經理 李喬

人工智能的三要素包括數據、算法及算力。作為AI原料的數據是十分有限的,可利用的公域數據在2026年之前就會被大模型全部訓練完成。場景化AI訓練、微調的數據來源將尤其依賴于有價值的私域數據,但私域數據往往是不開放的,隱私計算和聯邦學習則將成為打破數據孤島極為可行的方案,同時合成數據技術的應用也將成為必然。此外,算法復雜度呈指數級增長,模型層數、參數規模快速膨脹的同時也在不斷突破。當下,三要素中的算力成為了很多應用落地的最大瓶頸。那么,AI算力基礎架構具體面臨哪些挑戰與機遇?

一、挑戰

在AGI時代,數據大模型的參數規模呈現出快速增長的態勢。GPT從2018年的1.17億發展到2020年的1750億,文心一言3.0參數規模達到了2600億,Google的Palm 2參數量也超過3400億。隨著參數模型的日益龐大、摩爾定律陷入瓶頸。對計算效率精盡的追逐,使得馮?諾依曼結構的先天性不足被成倍放大。計算墻、內存墻、通信墻、能耗墻成為了AGI算力基礎架構的四大挑戰。

首先談談AI計算的主角GPU。大模型并行計算量巨大,以GPU/TPU代替CPU進行大量簡單重復計算,雖然計算效率有了明顯的提升,但單卡算力和大模型所需總算力之間仍然存在巨大差距。以GPT-3為例,每進行一次訓練迭代需要消耗4.5ExaFlops算力,而主流GPU單卡算力只能達到TFlops級別。百萬級別的算力差距便產生了算力墻。分布式訓練在一定程度上解決了算力墻問題,但綜合考慮TCO及不同的AI場景,使用專業的芯片和異構計算架構將成為突破算力墻的另一個必要方向。

參數量是衡量模型大小的最關鍵指標,參數越多對內存的需求越大。以1750億參數的GPT-3為例,參數量(FP16精度)需要350GB內存(175B*2Bytes),梯度(FP16精度)需要350GB內存(175B*2Bytes),優化器狀態(FP32精度)需要2100GB內存(175B*12Bytes),總計需要2800GB內存(350GB+350GB+2100GB)。而主流的GPU卡僅能夠提供80GB顯存,單個GPU無法裝下如此龐大的參數量。此外,現有的計算架構以CPU為中心,CPU主內存與GPU本地內存無法統一尋址,內存資源相互隔離,GPU無法高效的使用CPU主內存資源,最終導致產生內存墻。

我們在利用大型分布式訓練解決算力墻和內存墻問題的同時,又產生了通信墻。不同的并行訓練方式下,服務器內及服務器間會分別引入AllReduce、AlltoAll、梯度數據聚合與分發等通信需求,通信性能強弱將影響整體計算速度的快慢。以千億級參數規模的大模型訓練為例,單次計算迭代內梯度同步需要的通信量就達到了百GB量級。此外,AI大模型訓練是一種帶寬敏感的計算業務,測試數據表明,采用200G網絡相對于100G網絡,會帶來10倍以上的性能提升。基于以上兩方面,一張能夠為機間通信提供高吞吐、低時延服務的高性能網絡十分重要。服務器的內部網絡連接以及集群網絡中的通信拓撲還需要進行專門設計,實現算網的高效協同。

大模型的訓練和推理是兩頭能量怪獸,勢必帶來極大的功耗。當前業界主流的8卡GPU服務器最大系統功耗高達6500W,用于GPU服務器之間互聯的128口400G以太網交換機的功耗也接近3500W。以ChatGPT為例,要滿足每天2.5億的咨詢量,需使用3萬張GPU卡,那么,僅僅在推理環節每天消耗的電費就超過50萬元(按照每度電0.8元計算),因此能耗墻是每個運營者都要面對的現實問題。

算力墻、內存墻、通信墻和能耗墻這四大挑戰之間存在一定的關聯性,我們不能靠簡單的堆砌來解決問題,產品架構的系統性設計顯得的更為重要。新華三在計算、網絡、存儲方面都有長期的積累和沉淀,能夠系統性地研究和考慮以上的問題,并提出相應解決方案。

二、算力墻應對之道

面對AGI時代算力的爆發式增長需求,單一處理器無法同時兼顧性能和靈活度。在此情況下,用最適合的專用硬件去承擔最適合的計算任務,并采用異構計算架構去整合這些多元算力,是突破算力墻的有效手段。

在當前的AI訓練場景,NVIDIA高端GPU是市場上的“硬通貨”,其2023年發布的Hopper架構是NVIDIA GPU的集大成者,一經推出便受到市場的青睞。

除了采用GPU外,為人工智能業務開發專用的AI芯片逐漸成為業界的新趨勢。

在AI芯片領域,最具代表性的是Google TPU(Tensor Processing Unit)。發布于2016年的第一代TPU成為了 AlphaGo 背后的算力擔當,當前已經發展到了第四代的TPU v4。與 GPU 相比,TPU采用低精度計算,大幅降低了功耗,加快了運算速度。

Meta也發布了MTIA(Meta Training and Inference Accelerator)自研AI芯片,該芯片采用RISC-V開源架構,可應用在自然語言處理、計算機視覺、推薦系統等領域。

除了AI芯片日益多元化之外,AI芯片間的高速互聯技術也是突破算力墻的關鍵。

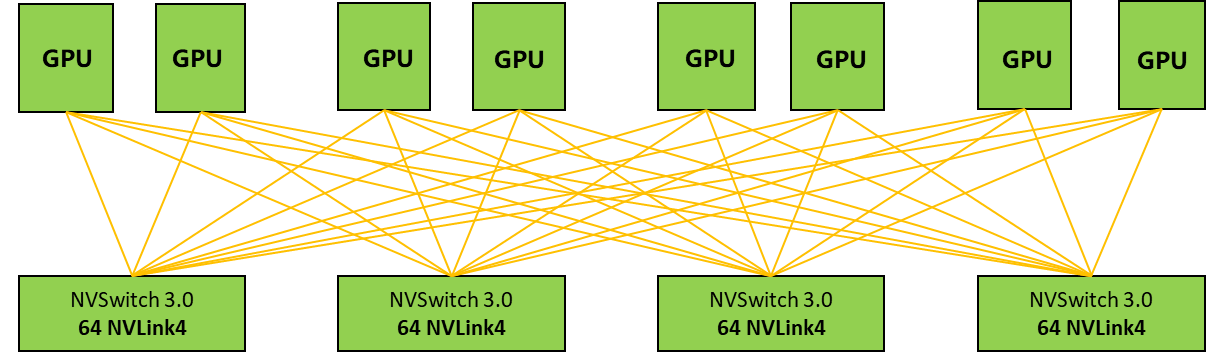

NVDIA首創了NVLink + NVSwitch技術,為多GPU系統提供更加快速的互聯解決方案。借助NVLINK技術,能最大化提升系統吞吐量,很好的解決了GPU互聯瓶頸。最新的NVIDIA Hopper架構采用NVLINK4.0技術,總帶寬最高可達900GB/s。

2023 年 5 月 29 日,NVIDIA推出的DGX GH200 AI超級計算機,采用NVLink互連技術以及 NVLink Switch System 將256個GH200 超級芯片相連,把所有GPU作為一個整體協同運行。

Google推出的OCS(Optical Circuit Switch)光電路交換機技術實現TPU之間的互聯,解決TPU的擴展性問題。Google還自研了一款光路開關芯片Palomar,通過該芯片可實現光互聯拓撲的靈活配置。也就是說,TPU芯片之間的互聯拓撲并非一成不變,可以根據機器學習的具體模型來改變拓撲,提升計算性能及可靠性。借助OCS技術,可以將4096個TPU v4組成一臺超級計算機。

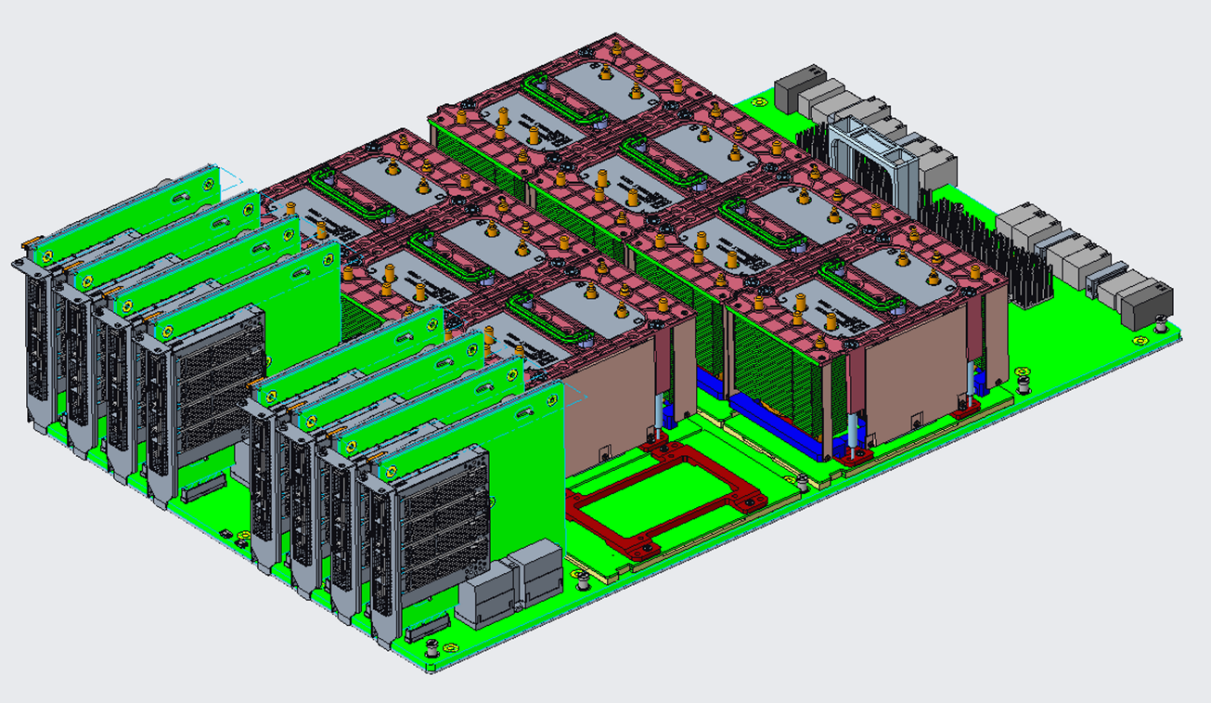

為了滿足了AI加速芯片的互聯需求,OCP組織2019年成立了OAI開源項目組,通過OAM子項目定義業界通用形態的GPU/AI模塊、對外提供標準通信接口,建立OAI相關的技術架構。芯片廠家只要將其GPU/AI加速芯片做成OAM模塊的形態,通過UBB來承載多個OAM模塊,就可以在任何支持OAM/UBB模塊的服務器上兼容使用。

新華三作為OAI 2.0規范的主要起草單位,在國產化OAM方面多有相應的落地實踐。那么如何在AI算力日益多元化的情況下,如何有效整合這些多元算力?采用異構計算技術是最佳選擇。在異構計算領域,新華三開展了廣泛的實踐,H3C Uniserver R5500 G6踐行異構計算設計理念,可搭載Intel或AMD CPU,機箱天然兼容NVIDIA Hopper架構GPU以及OAI架構,同時提供對多家廠商DPU的支持能力,為不同的應用場景提供了澎湃算力。

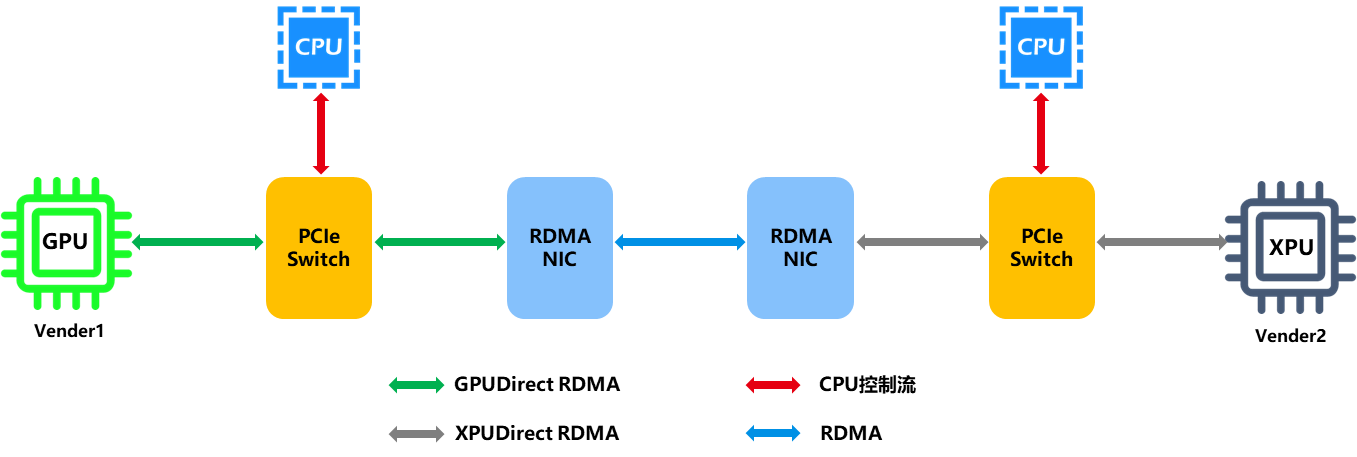

未來,還可采用類似XPU Direct RDMA的異構芯片通信技術,實現異構計算平臺互聯。XPU通信時不再需要CPU中轉,大幅減少數據拷貝的次數,提升了通信性能,有效整合了多元算力。

三、內存墻應對之道

隨著服務器向異構計算架構轉型,傳統的PCIe互聯模式已經無法滿足高速緩存一致性和內存一致性的需求。GPU加速卡無法使用Host主機自帶的內存資源,無法很好的解決AI大模型訓練場景遇到的內存墻問題。為此,迫切需要在服務器內使用新興的互聯架構,突破內存墻的限制。

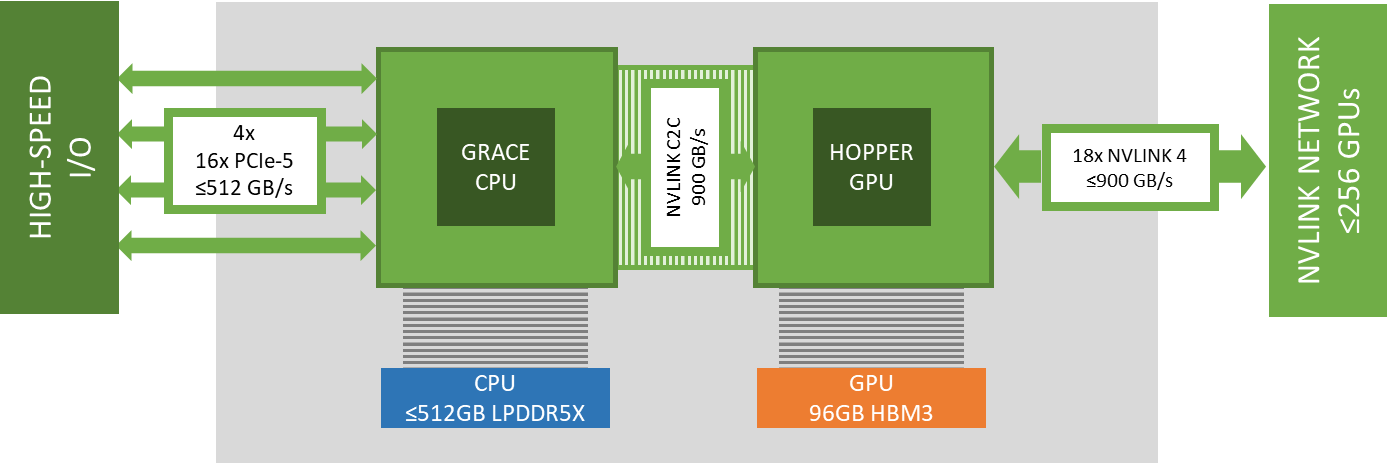

NVIDIA Grace Hopper架構中,完美的解決了大模型訓練的內存墻問題。在該架構中,Grace CPU和Hopper GPU使用帶寬高達900 GB/s NVLink C2C鏈路互聯,GPU可以通過NVLink C2C透明地訪問CPU上的512GB內存資源。

NVIDIA通過Grace Hopper向業界展現了突破內存墻問題的解決方案。此外,AMD推出的 Instinct MI300,英特爾推出Falcon

Shores也采用了類似的解決方案來突破內墻問題。但這些都屬于私有技術。有沒有一種開源方案既能解決大容量內存問題和內存一致性問題,又能避免對現有協議體系完全顛覆?

Intel聯合其他8家科技巨頭于2019年成立的CXL(Compute Express Link)聯盟就致力于解決該問題。

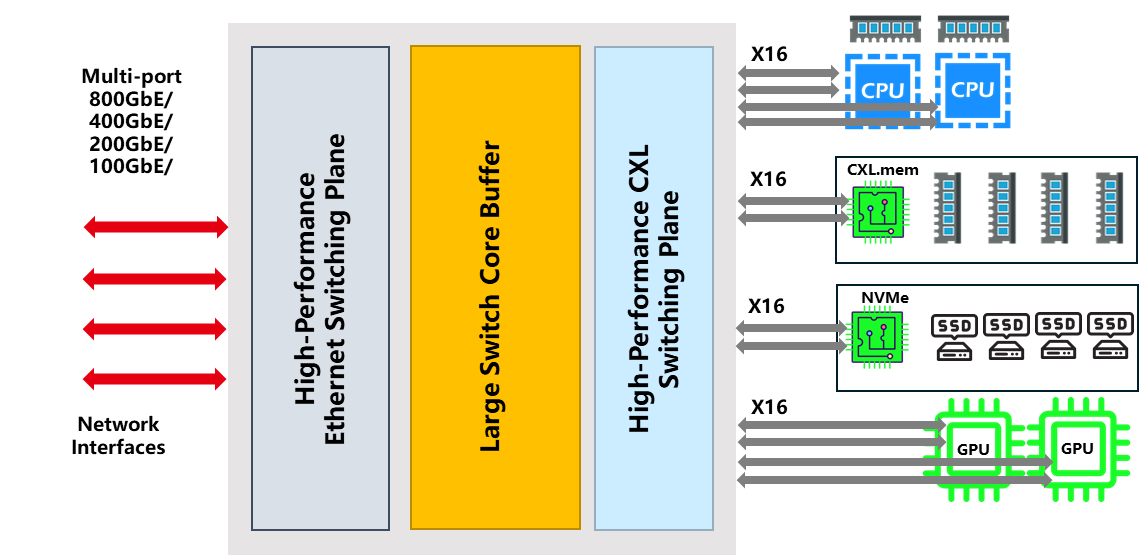

CXL是一種開源的互聯技術標準,能夠讓CPU與GPU、FPGA或其他加速器之間實現高速互聯,并且維持CPU內存空間和加速器設備內存之間的一致性,以滿足資源共享、內存池化和高效運算調度的需求。CXL組織已經發布CXL3.0版本,數據傳輸速率提升至 64 GT/s,并引入了Fabric功能和管理、改進的內存共享及池化技術、增強的一致性以及對等通信等重要功能。 放眼未來,CXL4.0基于PCI-Express 7.0標準,擁有更高的容量(512GB/S)和更低的延遲,將在性能上實現另一個層級的躍升。

當前,各大上游廠商都在開發或已推出支持CXL協議的部件,實現GPU顯存與主機內存的統一尋址,解決內存墻問題已經近在眼前。暢想未來,隨著CXL Switch等關鍵部件的進一步發展,我們可以實現CPU、GPU、內存等資源的進一步池化,各資源池通過CXL Switch互訪互通,在集群層面實現全局內存一致性。

新華三在2019年4月正式加入了CXL組織,并于2022年升級為Contributor會員。新華三在CXL技術研究上進行了持續的投入,目前正在開展基于CXL技術的內存池化、異構互聯方面的研究。

四、通信墻應對之道

在集群網絡方面,為大模型訓練優化過的無損網絡解決方案可提供高吞吐和低延時的網絡服務,確保在大規模訓練時集群的性能。

4.1端網融合的RoCE無損網絡

RoCE網絡是基于以太網 RDMA技術實現的,它比IB更加開放。RoCE可以基于現有的以太網基礎設施進行部署,網絡管理更加簡化。但RoCE也面臨著一些挑戰,比如ECMP負載不均、哈希沖突、PFC死鎖等。基于IP協議的開放性,出現了多種針對RoCE的優化方案,其核心思想即將服務器、網卡、交換機作為一個整體,結合創新的擁塞控制算法,實現端網協同。

Google數據中心使用的TIMELY算法,由網卡進行端到端的RTT時延測量,根據RTT時延數據調整發送速率,實現高性能的RoCE網絡。TIMELY算法使用谷歌自研網卡實現,主要應用在Google內部。

阿里團隊提出的HPCC擁塞控制算法,它使用可編程交換機,通過INT遙測攜帶網絡擁塞數據,然后由智能網卡動態調整發送速率,獲得高帶寬和低時延的高性能網絡。

EQDS(edge-queued datagram service)是目前被廣泛討論的另一種擁塞控制解決方案。它將網絡中的絕大部分排隊操作從交換機轉移到發送端網卡上,使得交換機可以采用很小的緩存設計。EQDS由接收端網卡驅動,通過Credit機制,來指導數據包發送。另外EQDS使用Packet Spray實現逐包的負載均衡,以解決負載不均和哈希沖突的問題。如果交換機支持DCN(Drop Congestion Notification)技術,可以由交換機實現數據包修剪(Packet Trimming),僅將擁塞報文的報文頭發送給接收端,接收端接收到報文頭后,可以要求發送端快速重傳數據包。實驗表明,EQDS在測試中表現出色,能夠顯著提高數據中心網絡的性能。

新華三正在研究基于自研服務器、智能網卡和高性能交換機,實現端網融合的RoCE無損網絡解決方案,為AI業務提供高性能無損通信網絡。

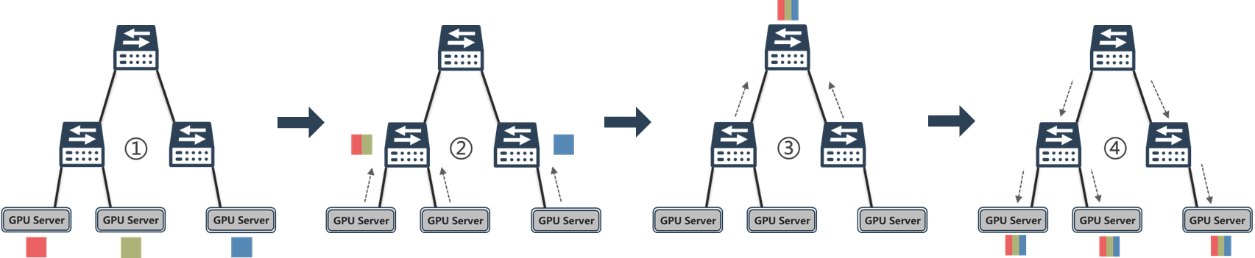

4.2在網計算

除了通過增加網絡帶寬、提升鏈路利用率、優化擁塞控制算法外,在網計算(In-Network Computer)是另一種優化通訊開銷的重要手段。在網計算(In Network Computing)可以將AI分布式訓練的集合通信操作卸載到網絡設備上,讓網絡設備參與計算,減少計算節點之間的消息交互,大幅縮減AI分布式訓練的時間。

以集合通信中使用頻率最高的AllReduce規約運算為例,從各節點收集梯度,將訓練過程中的匯總規約卸載到集成了計算引擎單元的網絡交換機中進行,然后再更新至每一個節點。通過在網計算技術,加速了整個Allreduce的過程,可以有效的減少網絡擁塞和降低通信延遲。

新華三積極投入在網計算技術的研發,借助可編程交換芯片或在傳統交換機中引入FPGA芯片實現在網計算,提升AI訓練的整體性能。

4.3高速以太網及光互聯

算力需求的爆發式增長推動了數據中心網絡向800G、1.6T及更高速率快速演進。光模塊作為網絡互聯的關鍵部件,隨著速率的提升其功耗也一路攀升,在整機系統的占比已經遠超ASIC加風扇功耗之和。另外,高速光模塊在數據中心網絡建設中的成本占比也在大幅提升。為了應對由此帶來的功耗、成本和時延挑戰,業界出現了兩種最具潛力的解決方案。

LPO線性直驅技術去掉了光模塊中功耗最高的DSP芯片,由交換機ASIC芯片來對高速信號進行補償和均衡,在實現成本下降的同時,大幅降低了光模塊的功耗和延遲,非常適合應用在短距大帶寬、低功耗低延時的AI/ML場景。

傳統可插拔光模塊到交換機ASIC芯片電信號連接距離較長,途經點較多,累積損耗大。通過CPO/NPO等封裝技術的引入,顯著縮短了交換芯片和光引擎間的距離,同時能夠提供更高密度的高速端口,更適合在1.6T速率后實現高算力場景下的低能耗、高能效。

在高速互聯技術領域,22年新華三發布了采用NPO技術的400G硅光融合交換機S9825-32D32DO, MPO光引擎接口支持2KM傳輸距離,端口功耗降低40%以上。

2023年,新華三進一步推出了采用共封裝技術的CPO交換機,對外提供64個800G接口或128個400G接口,并計劃今年內推出支持LPO線性驅動光模塊的128口400G,64口800G端口的交換機產品。未來,新華三將通過持續的技術創新為AI業務提供高性能、低延遲、低能耗的通信網絡,破解通信墻的難題。

五、能耗墻應對之道

降低AI模型整體能耗的主要方式依然是提高數據中心的散熱效率,液冷散熱方案因其低能耗、高散熱、低噪聲、低 TCO 等優勢,有著巨大的發展潛力。

其中,浸沒式液冷散熱是典型的直接接觸型液冷,發熱元件與冷卻液直接接觸,散熱效率更高,噪音更低。目前,浸沒式液冷方案已由初期的單相式液冷進化為相變式液冷,充分利用冷卻液的蒸發潛熱,滿足散熱極端要求,保證IT設備滿功率運行。

目前,新華三在浸沒式液冷方案方面完成了全面布局,緊跟互聯網業務發展步伐,秉承產學研一體理念,從冷板式液冷到浸沒式液冷,從單相式液冷到相變式液冷,從3M冷卻液到國產冷卻液,積極研究跟進推出新華三液冷系統一體化解決方案,包含液冷交換機、液冷服務器、熱交換單元、外冷設備等,并且在液冷方案方面持續進行方案迭代和前沿技術探索。

六、展望

本文主要從基礎架構角度去討論如何應對AGI時代的挑戰。隨著數據、算力及算法取得不斷的突破,人工智能將會重塑整個經濟、社會、產業和人們生活的方方面面。這就要求互聯網公司整合各類資源打造垂直的生態,借助生態伙伴的力量實現科技成果轉化,更好的賦能百行百業。新華三作為數字化解決方案領導者,具備百行百業的解決方案能力,通過把互聯網公司的大模型能力融入到新華三解決方案中,可以開展面向政府、企業、金融、醫療、教育等場景的N項業務合作,共同應對快速場景化落地的挑戰。